En 1982 se estrenó la película Blade Runner, basada parcialmente en la novela de Philip K. Dick ¿Sueñan los androides con ovejas eléctricas? (1968).

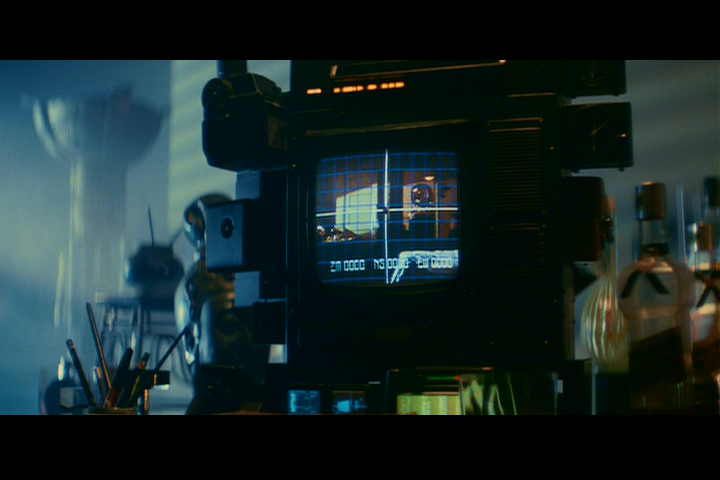

En la película, ambientada en el año 2019, podemos ver una herramienta que no aparece en el libro (y que sí aparecería más tarde en el videojuego de la desaparecida Westwood Studios): el Esper, una televisión bastante aparatosa que permitía, mediante comandos de voz, explorar la fotografía de una escena guardada previamente en un CD. A continuación tenéis un vídeo de la película donde se puede ver el Esper en funcionamiento.

El Esper tiene un par de virtudes que merecen la pena ser comentadas:

- Por más que se haga zoom en la imagen, la nitidez sigue siendo la misma.

- La cámara es capaz de ver a través de las esquinas.

Superresolución

Estamos cansados de ver en la serie CSI y en muchas otras series y películas cómo Horatio (o el jefe de turno) llega a la sala de informática forense y tras mirar detenidamente la imagen captada por la cámara de tráfico y observar disgustado que la cara del sospechoso es irreconocible pregunta:

—¿Puedes mejorar la imagen?— A lo que el técnico responde, después de haber pasado ya toda la mañana trabajando en la imagen (o quizás jugando al Candy Crush) —Puedo intentarlo—. Y tras aporrear el teclado durante aproximadamente 2 segundos la cara del sospechoso mejora y se puede identificar.

Claro que es posible mejorar una imagen computacionalmente. Existen cientos de algoritmos que juegan con la información capturada por la cámara para representarla de manera diferente, y muy posiblemente alguna de estas representaciones nos permitiría reconocer mejor una cara y llegar a una identificación que antes era imposible. Pero todos sabemos que lo que pasa en las series y películas va más allá, inventándose información que antes no había sido capturada por la cámara y que por lo tanto ¡es inexistente!

¿Cómo se puede solucionar este problema? La verdad es que de una forma muy simple: aumentando la resolución de la cámara. Pero no simplemente añadiendo más píxeles (esto sólo aumentaría el campo de visión de la cámara) sino que también es necesario que cada píxel obtenga información de una zona más pequeña de la escena.

Con un campo de visión de 120ºx50º esta cámara, cuyas virtudes fueron publicadas en el artículo Multiscale gigapixel photography en la revista Nature (2012) permite hacer fotografías de 0,96 gigapíxeles, abarcando cada píxel un campo de visión de 38µrad, o dicho de otro modo, 230 veces más pequeño que el ángulo que sustenta la Luna en el cielo.

La cámara está formada de 98 microcámaras. Esta característica tiene una ventaja importante, y es que permite regular la exposición de cada una de las cámaras por separado. A falta de una tecnología que permita un rango dinámico parecido al del ojo humano esta es una solución bastante aceptable.

Viendo a través de las esquinas

Esta característica es mucho más impactante. Mientras que en la técnica anterior "simplemente" consistía en mejorar una característica de las cámaras que ya conocemos, la resolución, ¿qué hacemos para ver a través de las esquinas? Necesitamos de una tecnología totalmente nueva para conseguir superar esta barrera arquitectónica.

¿Es posible ver a través de las esquinas? La respuesta es que es posible aunque todavía de un modo bastante rudimentario. Como tantas otras técnicas en la actualidad, ésta mejorará de forma sustancial con mayor poder de computación (cuestión de esperar unos años). Una de las técnicas que lo permite fue propuesta por el MIT en 2012. La técnica se basa en medir el tiempo de vuelo de fotones que reflejan en una superficie y alcanzan al objeto que está cubierto por la esquina. Parte de esos fotones vuelven a llegar a la cámara y las mediciones de estos tiempos permiten reconstruir el objeto que estaba oculto. En el siguiente vídeo se explica la tecnología de una forma muy fácil de entender.

Para conseguir entonces unos resultados similares a los vistos en la película de Ridley Scott tendríamos que construir una cámara gigapíxel que permitiese además lanzar pulsos de luz y calcular el tiempo que tardan en volver. Así tendríamos no sólo información capturada directamente por la luz que proviene de la propia escena sino que además tendríamos información de las partes de las que no llega luz directa (detrás de una puerta entreabierta, detrás de una mesa...).

El resultado de nuestra fotografía sería entonces un entorno tridimensional por el que podemos movernos y "girar" para descubrir información que, en una fotografía convencional no es capturada. Todo esto, junto con una interfaz de voz algo más amigable y menos robótico que los de hoy en día y ya tenemos nuestro propio Esper.

Retos

La fotografía de 0,96 gigapixeles se puede tomar en 1/5 de segundo pero la potencia y velocidad de escaneo del láser, la velocidad de reconstrucción, por no hablar de cómo conseguir información de color de los objetos que están ocultos para la imagen convencional... Esta parte de la tecnología necesita de mucho poder de computación y de sobrepasar alguna que otra barrera tecnológica. Sin embargo creo que hoy en día ya contamos con los cimientos necesarios para poder hacer realidad esta cámara algún día no muy lejano. ¿Qué os parece?